2009.03.25

SixthSense – ウェアラブルデータインターフェース

MIT Media LabのSixthSenseプロジェクトは、日常の実社会とデジタルデータをシームレスに統合することを目指している。

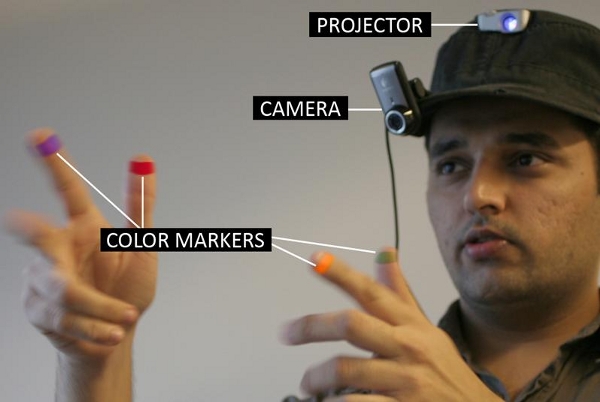

ハードウェアの一部は、モバイルウェアラブルデバイスのように首から提げる形になっています。プロジェクターとカメラは、ユーザーのポケットの中のモバイルコンピューティングデバイスに接続されています。プロジェクターは、身の回りの壁や物などに視角情報を投影し、そこをインターフェースとして使えるようにします。ユーザーの手のジェスチャーと物理オブジェクトをコンピュータービジョン技術を使ってカメラが認識し追跡します。ソフトウェアプログラムは、カメラが捕らえたビデオストリームデータを処理し、ユーザーの指に装着された色分けされたマーカー(視角追跡基準)を、簡単なコンピュータービジョン技術を使って追跡します。視角基準の動きと並び方からジェスチャーが解析され、投影されたアプリケーションのインターフェースに対するインタラクション命令として認識されます。追跡できる指の最大数は、一意の基準の数に応じて変化します。つまり、SixthSenseは、マルチタッチや、複数のユーザーによるインタラクションにも対応できるわけです。

まだまだ開発段階だけど、すごく便利そうだよね。ハードも、カメラとプロジェクターとジェスチャー用のマーカーと比較的小さいし。利用方法は山ほど考えられる。チップのデータシートが自動的に目の前に投影されるとかね。ハンダごてから手を離す必要もない。;)

– Collin Cunningham

訳者から:万博チックなムービーがすごいな。明るい未来って感じでワクワクさせられる。こういう感覚が大切だよね。

[原文]