2017.08.14

Maker Faire Tokyo 2017レポート:農業、釣り、野鳥観察、そして未来を感じさせるプロジェクトまで、人工知能を使った展示たち

人工知能(AI)に関する技術はここ数年で急激に高まっている。Maker Faire Tokyoでも人工知能をさまざまに利用した展示が見られた。その中からいくつか紹介したい。

きゅうり仕分けメカがパワーアップ

「きゅうり仕分け3号機」の操作部分。近所にファブ施設ができ、パネルの製作にレーザーカッターを使えるようになったという

「きゅうり仕分け3号機」(Workpiles)は去年のMaker Faire Tokyo 2016で大きな話題となった、きゅうり選果マシン「CUCUMBER-9」の最新版である。

今回は上向きの液晶ディスプレイにアクリルパネルを置き、そこへきゅうりを配置する。パネルの上からカメラで画像認識し、ディスプレイにそれぞれのきゅうりの等級が表示されるしくみになった。判別させる際に教師データの収集も行うようにしたという。

等級を判別されたきゅうりを仕分ける機構は「きゅうりが傷むため」いったん廃止された。きゅうりを配置したり、仕分けされたきゅうりを分ける作業は現状、人の手で行う。

教師データとなるきゅうりの写真は去年の7,000枚から32,000枚へと大幅に増えた。これで正答率は80パーセントだそうで、案外高くないと感じるかもしれない。これはまったく同じ形と大きさのきゅうりでも、時期によって等級が変わることがあるからだそうだ。具体的には、「この時期のきゅうりは全体的に太めなので、いつもより太くてもよい等級にしよう」といったぶれが入るのだという。つまりきゅうりの等級分別はある程度相対的なものであり、人工知能にはハードルが高い。現在は、ぶれを補正する方法も検討中であるとのこと。

より詳しく:キュウリの仕分け機(試作3号機) – その1 – | Workpiles

「魚キャッチセンサー」は寒い日の釣りの強い味方

BLE通信が可能な小型のArduino互換モジュール「Bluno nano」とジャイロセンサーを使用

「のうぐらぼ」が去年に引き続き展示していたのは、寒い時期の釣りに便利な「魚キャッチセンサー」。魚がかかったときの竿のしなりを判定してアラートを出してくれるので、あたりを待つ間は竿を離れて車の中など暖かい場所にいられる。波などで竿がゆれてもアラートが出ないよう調整されており、実際に釣果も上がっているという。

今年はセンサーを無線化したほか、3軸の加速度の記録を取るようにした。データを蓄積し解析することで、将来的には魚がかかった段階で魚種を特定できるようにしたいということだった。

より詳しく:Maker Faire Tokyo 2017 のうぐらぼ/NogueLab 出展!! 2017/08/06 | のうぐらぼ / NogueLab

えさ台に来る鳥を種類も含めて記録する「自動野鳥観測システム」

小型PCは機械学習に向くNVIDIA Jetson TX1を使用

「F工作部」が展示していたのは「自動野鳥観測システム」。庭先などに設置したえさ台にWebカメラと小型PCを追加して、えさ台に来る野鳥を記録する。

えさ箱に来る野鳥の写真を撮るだけならば、ここまでのシステムにする必要はない。写真から鳥の種類を判別し分類、集計したいというニーズがあると知り、作ってみたそうだ。このシステムを使えばどの鳥がいつごろ、どのくらい来るのかを自動集計してくれる。鳥の写真や集計結果は無線LANで参照できる。

今のところ判定率はあまり高くなく、これは撮影時の鳥の姿勢がさまざまであることが原因ではないかという。今後は精度を上げて、実用性を高めていきたいということだった。

人工知能どうしを対話させるシステム

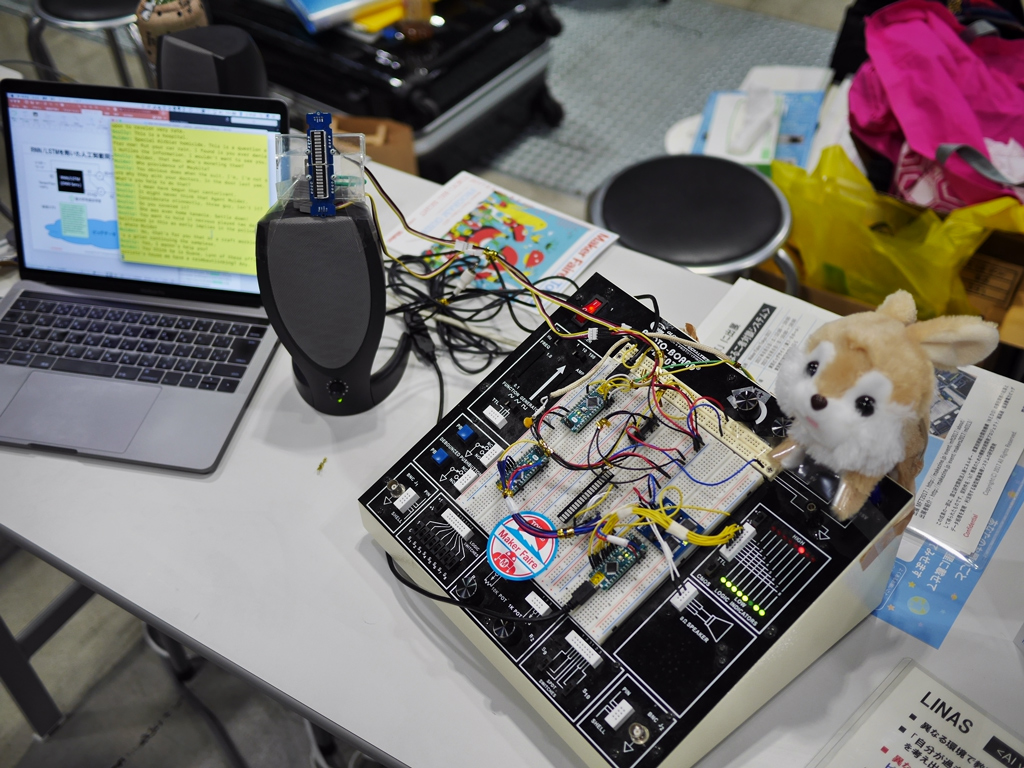

「LINAS」が出展したのは「人工知能による二者対談システム」。既存の会話データを解析し、対話できるようにしている。展示されていたのは日本語のものと英語のものの2種類で、いずれも性別や性格が異なる2つのAIが対話するシステムになっていた。

このような対話AIを作るには、元となる会話データの収集が必要となる。日本語の対話AIのもととなったのは、夫婦の15年分のチャットログをまとめた数メガバイトのテキストデータ。英語のAIには、テレビドラマ「X-ファイル」のセリフをすべて書き起こしたWebサイトから拝借したテキストデータを読み込ませた。ドラマや映画のセリフを書き起こしたWebサイトは数多くある中、「X-ファイル」は主人公の男女が議論するシーンが長く、このような対話AIを構築するのに向いていたという。

日本語の対話AIのログ。リアルタイムな対話デモではない。「夫婦の個人的な会話をもとにしているので、外にお見せできる内容になっているところを切り出して表示しています」とのこと

会場でリアルタイムに生成されていた英語の対話AI。スピーチモジュールで音声出力もしていた。一方がしゃべるとき、右側のぬいぐるみがぴょこぴょこ動く。「ネイティブの方に読んでもらったところ、それらしい会話が生成されているという評価でした」

これらの対話AIは人間ともやり取りできる。長いフライトで時間を持て余したときなど、奥さんのAIと対話したりしているという。「確かに本人とチャットしているような気持ちになります」とのこと。自分のAIと対話してもらった人の評価も「本人みたい」と悪くない。一方、自分のAIとのチャットは「とても気持ちが悪い」という。自分のものまねを見せられるような居心地の悪さがあるようだ。

会話データの機械学習には、強力なGPUを持つNVIDIA TITANを使用した。GPUを使わないと1週間かかる解析が3時間ほどで終わるため、パラメータを頻繁に調整して試行錯誤できるメリットがあるそうだ。

PPAPから着想したAIの裏側には壮大なビジョンがあった

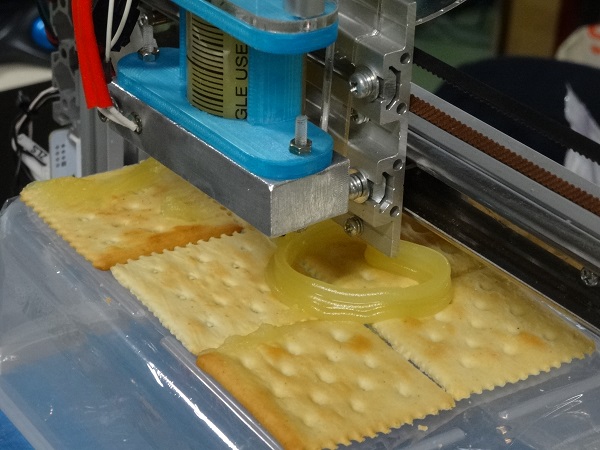

ペンとバイナップルとリンゴを判別するという、10年たつとなぜそれを判別したくなったのかわからなくなるかもしれない「PPAP Box」を出展していたのは「eunoi11」。前回のMaker Faire Tokyoで見た、上述のきゅうり仕分けAIにインスパイアされて機械学習を始めてみようと考えたそうだ。

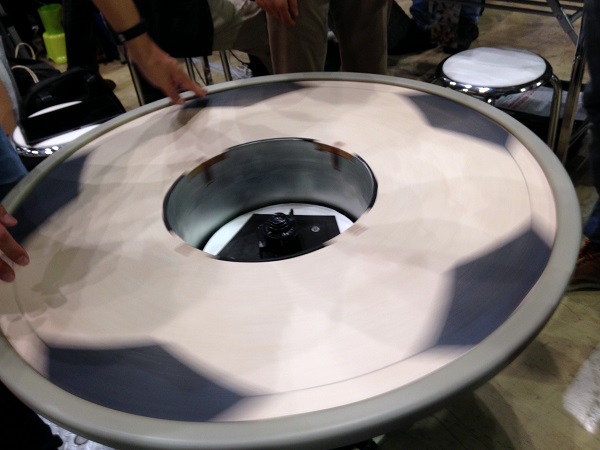

PPAP Boxは見せ方にもこだわっている。球状のオブジェはニトリで買った照明のカバーを流用しているという

単純にペンとパイナップルとリンゴを判別させるだけなら、カメラが1つあればよい。どれも形状や色が大きく異なるからだ。しかしそれだけでは面白くない、人間のように五感を使ってあらゆるものを判別できるようにしたいという。それを聞くと「PPAP Box」は決して一発ネタではないとわかる。「においセンサーにいいものがなかなかない、硫化水素などのガスを検知するものはあるが、果物のにおいを区別するものがない」とピコ太郎のコスプレで語る姿は本気だった。